Live Captions, новая функция, появившаяся в iOS 16, будет генерировать субтитры для любого звука, воспроизводимого в любом приложении на вашем iPhone. Возможность превращать слова из музыки и/или видео в текст в режиме реального времени на основе Neural Engine в специализированном кремнии Apple станет благом для многих пользователей в самых разных ситуациях.

Например, если вы плохо слышите, возможность видеть мгновенные подписи на экране меняет правила игры. Или, если у вас нет наушников, когда вы сидите в постели поздно ночью, а ваш партнер спит — или вы находитесь в каком-либо ситуации, когда вы не хотите шуметь, например, в автобусе или в офисе — вы можете включить Live Captions, чтобы получить субтитры.

Приложения бесконечны и увлекательны. Вот как использовать Live Captions в iOS 16.

Как использовать Live Captions в iOS 16

Live Captions произвели фурор в мае, когда Apple анонсировала эту функцию. наряду с другими новыми функциями специальных возможностей выходит на iOS. Эти функции получили свой собственный день в центре внимания, чтобы отметить

Всемирный день осведомленности о доступности перед WWDC22, где Apple изложила свои планы относительно iOS 16 и других своих операционных систем. Тем не менее, все они прибудут в сентябре этого года с все остальное в iOS 16.Однако любой, кто не боится попробовать бета-версию, может попробовать Live Captions и другие новые функции iOS 16 прямо сейчас. Во-первых, вам нужно установить бета-версию iOS 16 (либо версия для разработчиков или бесплатная общедоступная бета-версия), желательно на запасной телефон, так как ПО остается глючным.

iOS 16 совместима со всеми iPhone, выпущенными в 2017 году и позже: моделями iPhone 8, X, XS, 11, 12, 13 и iPhone SE (второго и третьего поколения).

Включить живые субтитры

Скриншот: Д. Гриффин Джонс/Культ Мака

Как только вы все настроите на бета-версию iOS 16 (и после того, как вы возитесь с создание пользовательского экрана блокировки), перейти к «Настройки» > «Универсальный доступ» > «Живые субтитры» (бета-версия) ближе к концу списка.

включить Живые субтитры чтобы включить эту функцию. Появится плавающий виджет, ожидающий подписи. В другом месте в настройках вы можете настроить этот виджет так, чтобы он появлялся и исчезал из Центра управления или тройным нажатием боковой кнопки, но сначала давайте посмотрим, как он работает (нажмите здесь, чтобы пропустить вперед).

Также включите Живые субтитры в FaceTime пока вы здесь, чтобы получить субтитры в следующий раз, когда вы разговариваете по FaceTime.

Насколько хорошо работают Live Captions?

Справедливое предупреждение: несмотря на все мои усилия, я не могу заставить виджет Live Captions появляться на моих скриншотах. Я даже пытался подключить телефон к компьютеру и записывать экран в QuickTime, но безрезультатно.

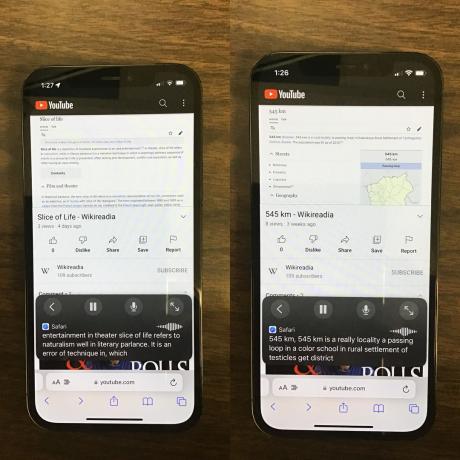

Ниже приведены фотографии моего телефона, которые я сделал со (старым) iPad. Мне жаль.

Живые титры в видео на YouTube

Фото: Д. Гриффин Джонс/Культ Мака

Я протестировал Live Captions, чтобы вы могли сразу увидеть, насколько точны субтитры. Смотрите, я бегал видео эксперимент на ютубе в течение последних двух лет, когда я рассказываю статьи из Википедии целиком. Это удобно, потому что вы можете сравнить, насколько хорошо Live Captions транскрибирует мой рассказ с исходным текстом на экране.

Как видите, результаты… не очень. Это немного удивительно. Голосовая диктовка отлично работает для меня в iMessage; Сири обычно хорошо понимает мой голос. Насколько мне известно, мой голос в видео звучит так же, как и при обычном использовании iPhone. И все же Live Captions довольно плохо расшифровывает мои видео на YouTube.

Подкасты

Фото: Д. Гриффин Джонс/Культ Мака

Я люблю читать новости через NetNewsWire и слушать комментарии через подкасты. Могу ли я еще больше укрепить это, используя Live Captions, чтобы превратить подкасты в письменные слова? Что-то вроде.

Даже там, где это работает лучше всего, нам приходится решать вопрос реализации: вы не можете запускать весь эпизод подкаста с помощью Live Captions и прокручивать полученный текст, читая его как статью. Live Captions обрабатывает звук так, как он его слышит.

Это означает, что вы можете читать по несколько строк за раз с той же скоростью, с которой произносится диалог. Кроме того, поскольку Live Captions слышит конец предложения, он может работать в обратном направлении и исправлять начало этого предложения. предложения, добавляя знаки препинания или заменяя похожие по звучанию слова, как это происходит при использовании диктовки на вашем айфон. По сути, из трех строк текста получается только одна, которую вы можете прочитать.

Если вы коснетесь полноэкранных стрелок, вы сможете сразу прочитать больше, но это скрывает элементы управления приложением для приостановки и пропуска глав.

Также ясно, что это не очень хорошо сочетается с два чувака разговаривают жанр подкастов. Вы не можете сказать, кто что говорит, просто прочитав текст.

Live Captions для музыкальных текстов

Фото: Д. Гриффин Джонс/Культ Мака

Я совершенно ужасно разбираюсь в текстах песен. Есть альбомы, которые я слышал буквально сотни раз, тексты которых я до сих пор не могу запомнить, не говоря уже о том, чтобы понять. Apple Music предоставляет живые тексты для многих популярных музыкальных произведений, но, как ни странно, не для всей дискографии Пони-клуб без дрифта, величайшая инди-рок-группа в мире.

Итак, можете ли вы использовать Live Captions для анализа текстов песен? Еще одна смешанная сумка. Когда он может подобрать слова, они, как правило, довольно точны. Однако они приходят и уходят непредсказуемо.

На акустическая песня который, как я думал, будет легким хоум-раном, Live Captions решили транскрибировать одиночную гитару, слегка бренчащую на заднем плане, как «de de de de de de de» вместо произнесенной лирики. После обновления до бета-версии 3 для разработчиков, когда я сделал снимок экрана выше, вместо этого Live Captions подобрали частичную лирику (на фото слева).

Я также попробовал две заведомо сложные песни, чтобы попытаться отключить функцию Live Captions. Устное вступление к «У тебя проблемы" из Музыкальный человек был на удивление хорошо подписан — то есть до тех пор, пока не включилась полная музыка (на фото справа). “Элементы” стал еще одним приятным сюрпризом: функция Live Captions правильно идентифицировала около половины элементов, записанных в быстрой записи.

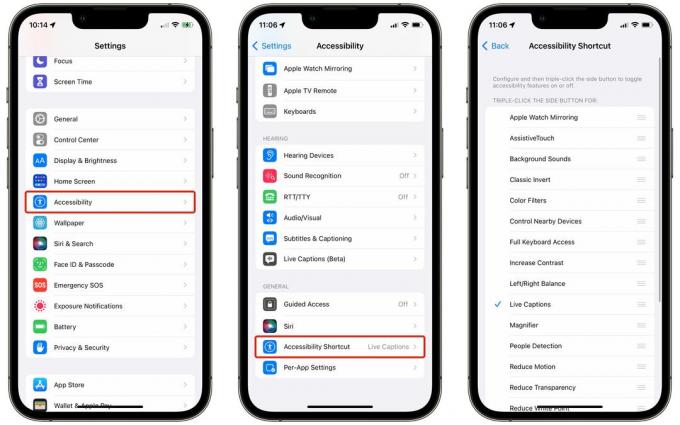

Скриншот: Д. Гриффин Джонс/Культ Мака

Если вы хотите продолжать использовать Live Captions, вам не нужно копаться в настройках, чтобы каждый раз включать и отключать плавающее меню управления.

Чтобы держать его под рукой, перейдите к Настройки > Специальные возможности > Ярлык специальных возможностей (в самом низу) и включить Живые субтитры. Теперь вы можете включить или отключить Live Captions, трижды щелкнув боковую кнопку iPhone.

Скриншот: Д. Гриффин Джонс/Культ Мака

Вы также можете добавить кнопку в Центр управления. Вернуться к Настройки > Центр управления и коснитесь зеленого + следующий на Ярлыки специальных возможностей. После включения проведите пальцем вниз от верхнего правого края дисплея (или, если у вас iPhone 8 или iPhone SE, от нижнего края), чтобы открыть Центр управления. Нажмите Значок доступности и выберите Живые субтитры включить это.

Как можно улучшить Live Captions?

Apple продолжает стремительно развиваться со своим Neural Engine. Машинное обучение явно является областью, в которой компания преуспевает, и темпы совершенствования только увеличиваются.

Сами подписи со временем должны стать более точными. Нынешняя функция диктовки Apple и обработка голоса для Siri работают лучше всего, когда вы говорите четко и держите телефон прямо перед лицом. Live Captions потребуется некоторое время, чтобы научиться переводить голоса в различных средах, где люди снимают видео на YouTube и общаются по FaceTime со своей семьей.

Я хотел бы увидеть API разработчика для этой функции. Проблема в том, что Live Captions расшифровывает любой звук, воспроизводимый из динамиков; функция не имеет понятия что такое играет, как долго длится звук или что будет дальше. Он не может обрабатывать звук заранее и не может быть подключен внутри интерфейса приложения.

Представьте, если бы в приложении «Подкасты» вы могли нажать кнопку, которая сразу обработала бы весь эпизод. Текст будет прокручиваться вместе с вами, пока вы слушаете, но вы также можете читать вперед или назад.

Возможно в iOS 17. 🤞