Live Captions, een nieuwe functie in iOS 16, genereert ondertitels van alle audio die wordt afgespeeld in elke app op je iPhone. Aangedreven door de Neural Engine in het aangepaste silicium van Apple, zal de mogelijkheid om woorden uit muziek en/of video's om te zetten in realtime tekst een zegen zijn voor veel gebruikers, in veel verschillende situaties.

Als u bijvoorbeeld slechthorend bent, is de mogelijkheid om onmiddellijke bijschriften op het scherm te zien een game-wisselaar. Of, als je geen koptelefoon hebt als je 's avonds laat in bed zit en je partner slaapt - of je zit in een situatie waarin u geen lawaai wilt maken, zoals in de bus of op kantoor — u kunt Live Captions inschakelen om ondertitels.

De toepassingen zijn eindeloos en spannend. Hier leest u hoe u Live Captions gebruikt in iOS 16.

Live ondertiteling gebruiken in iOS 16

Live Captions maakte een grote plons in mei toen Apple de functie aankondigde naast andere nieuwe toegankelijkheidsfuncties komt naar iOS. Deze functies kregen hun eigen dag in de schijnwerpers om te markeren

Wereldwijde toegankelijkheidsdag voorafgaand aan WWDC22, waar Apple zijn plannen voor iOS 16 en zijn andere besturingssystemen uiteenzette. Toch komen ze allemaal in september met al het andere in iOS 16.Iedereen die niet bang is om een bèta te proberen, kan Live Captions en de andere nieuwe iOS 16-functies nu echter proberen. Eerst moet je de iOS 16-bèta installeren (ofwel de ontwikkelaarsversie of de gratis openbare bèta), bij voorkeur op een reservetelefoon aangezien de software buggy blijft.

iOS 16 is compatibel met elke iPhone die in 2017 en later is uitgebracht: de iPhone 8, X, XS, 11, 12, 13 modellen en iPhone SE (zowel tweede als derde generatie).

Live ondertiteling inschakelen

Schermafbeelding: D. Griffin Jones/Cult of Mac

Zodra je helemaal klaar bent met de bètaversie van iOS 16 (en nadat je hebt gerommeld met .) een aangepast vergrendelscherm maken), ga naar Instellingen > Toegankelijkheid > Live ondertiteling (bèta) bijna onderaan de lijst.

Inschakelen Live bijschriften om de functie in te schakelen. Er verschijnt een zwevende widget, wachtend op iets om te ondertitelen. Elders in Instellingen kunt u deze widget configureren om te verschijnen en te verdwijnen uit het Control Center of door driemaal op de zijknop te klikken, maar laten we eerst eens kijken hoe het werkt (klik hier om verder te gaan).

Schakel ook in: Live ondertiteling in FaceTime terwijl je hier bent om ondertiteling te krijgen de volgende keer dat je een FaceTime-gesprek voert.

Hoe goed werken Live Captions?

Eerlijke waarschuwing: ondanks al mijn inspanningen krijg ik de Live Captions-widget niet in mijn schermafbeeldingen. Ik heb zelfs geprobeerd mijn telefoon op mijn computer aan te sluiten en het scherm in QuickTime op te nemen, maar het mocht niet baten.

Wat volgt zijn foto's van mijn telefoon die ik met een (oude) iPad heb gemaakt. Mijn excuses.

Live ondertiteling in YouTube-video's

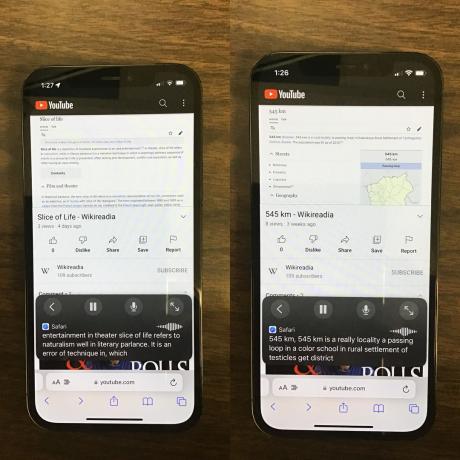

Foto: D. Griffin Jones/Cult of Mac

Ik heb Live Captions getest, zodat je direct kunt zien hoe nauwkeurig de ondertiteling is. Kijk, ik heb gerend een video-experiment op YouTube voor de laatste twee jaar waar ik Wikipedia-artikelen in hun geheel vertel. Dit is handig, want je kunt vergelijken hoe goed Live Captions mijn verhaal transcribeert naar de originele tekst op het scherm.

Zoals je kunt zien, zijn de resultaten... niet geweldig. Dit is een beetje verrassend. Spraakdicteren werkt geweldig voor mij in iMessage; Siri begrijpt mijn stem meestal redelijk goed. Mijn stem klinkt, voor zover ik weet, hetzelfde in de video's als tijdens normaal iPhone-gebruik. En toch transcribeert Live Captions mijn YouTube-video's behoorlijk slecht.

Podcasts

Foto: D. Griffin Jones/Cult of Mac

Ik lees het nieuws graag door NetNewsWire en luister naar commentaar via podcasts. Kan ik dit nog verder consolideren door Live Captions te gebruiken om podcasts om te zetten in geschreven woorden? Soort van.

Zelfs waar het het beste werkt, moeten we een kwestie van implementatie aanpakken: je kunt niet een hele podcast-aflevering uitvoeren via Live Captions en door de resulterende tekst scrollen, lezend als een artikel. Live Captions verwerkt de audio zoals deze wordt gehoord.

Dat betekent dat je een paar regels tegelijk kunt lezen, met dezelfde snelheid als de dialoog wordt gesproken. Bovendien, aangezien Live Captions het einde van een zin hoort, kan het achteruit werken en het begin daarvan corrigeren zin, interpunctie toevoegen of klinkende woorden vervangen, net zoals bij het gebruik van dictaat op uw iPhone. In feite levert drie regels tekst eigenlijk maar één op die u kunt lezen.

Als u op de pijlen op volledig scherm tikt, kunt u meer tegelijk lezen, maar dat dekt de app-bedieningselementen voor het pauzeren en overslaan van hoofdstukken.

Het is ook duidelijk dat dit niet goed speelt met de twee kerels praten genre van podcasts. Je kunt niet zien wie wat zegt door alleen de tekst te lezen.

Live bijschriften voor muziekteksten

Foto: D. Griffin Jones/Cult of Mac

Ik ben absoluut verschrikkelijk in het begrijpen van songteksten. Er zijn albums die ik letterlijk honderden keren heb gehoord en waarvan ik de teksten nog steeds niet kan onthouden, laat staan begrijpen. Apple Music serveert live songteksten voor veel populaire muziek, maar verwarrend genoeg niet voor de hele discografie van Drijfloze Pony Club, de grootste indierockband ter wereld.

Dus, kun je Live Captions gebruiken om songteksten voor je te ontleden? Nog een gemengde tas. Wanneer het de teksten kan oppikken, zijn ze over het algemeen behoorlijk nauwkeurig. Ze komen en gaan echter onvoorspelbaar.

Op een akoestisch lied waarvan ik dacht dat het een gemakkelijke homerun zou zijn, besloot Live Captions om de enkele gitaar die licht op de achtergrond tokkelde, te transcriberen als "de de de de de de de" in plaats van de gesproken tekst. Na het updaten naar ontwikkelaarsbèta 3, toen ik de bovenstaande schermafbeelding ging maken, pakte Live Captions in plaats daarvan een gedeeltelijke songtekst op (links afgebeeld).

Ik heb ook twee notoir uitdagende nummers geprobeerd om te proberen de Live Captions-functie af te werpen. Het gesproken woord intro van “Je hebt problemen" van De muziekman verrassend goed ondertiteld - dat wil zeggen, totdat de volledige muziek begon (foto rechts). “De elementen” was nog een aangename verrassing, waarbij Live Captions ongeveer de helft van de elementen correct identificeerde in de snelvuuropname.

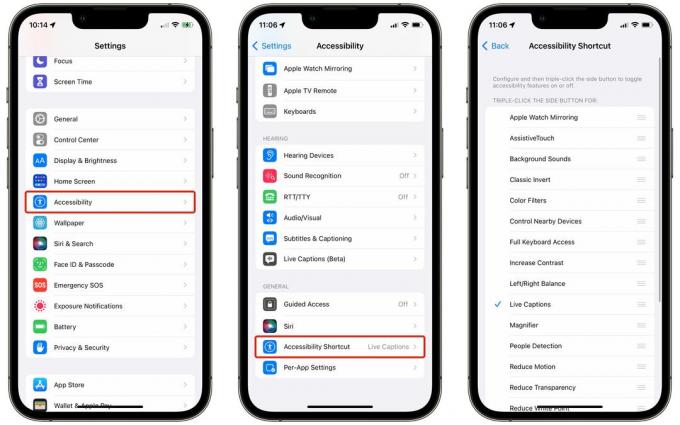

Schermafbeelding: D. Griffin Jones/Cult of Mac

Als u Live Captions wilt blijven gebruiken, wilt u niet in Instellingen graven om het zwevende bedieningsmenu elke keer in en uit te schakelen.

Om het bij de hand te houden, ga naar Instellingen > Toegankelijkheid > Snelkoppeling Toegankelijkheid (helemaal onderaan) en activeer Live bijschriften. Nu kunt u Live Captions in- of uitschakelen door drie keer op de zijknop van de iPhone te klikken.

Schermafbeelding: D. Griffin Jones/Cult of Mac

U kunt ook een knop toevoegen aan het Control Center. Ga terug naar Instellingen > Controlecentrum en tik op de groene + naast Toegankelijkheidssnelkoppelingen. Eenmaal ingeschakeld, veeg je naar beneden vanaf de rechterbovenhoek van het scherm (of, als je een iPhone 8 of iPhone SE hebt, de onderkant) om het Control Center te openen. Druk op Toegankelijkheidspictogram en selecteer Live bijschriften om het aan te zetten.

Hoe kunnen Live Captions verbeteren?

Apple blijft vooruitgang boeken met zijn Neural Engine. Machine learning is duidelijk een gebied waar het bedrijf uitblinkt, en het tempo van verbetering wordt alleen maar sneller.

De bijschriften zelf zouden in de loop van de tijd nauwkeuriger moeten worden. De huidige dicteerfunctie van Apple en de spraakverwerking voor Siri werken beide het beste als je duidelijk spreekt en je telefoon recht voor je gezicht houdt. Het zal enige tijd duren voordat Live Captions getraind is in het vertalen van stemmen in de vele omgevingen waarin mensen YouTube-video's filmen en hun familie FaceTimen.

Ik zou graag een ontwikkelaars-API voor deze functie zien. Het probleem is dat Live Captions alle audio transcribeert terwijl het uit de luidsprekers komt; de functie heeft geen concept van wat is? afspelen, hoe lang de audio duurt of wat er gaat komen. Het kan geen audio van tevoren verwerken en het kan niet worden aangesloten in de interface van een app.

Stel je voor dat je in de Podcasts-app op een knop zou kunnen drukken die een hele aflevering in één keer zou verwerken. De tekst scrolde met je mee terwijl je luisterde, maar je kon ook vooruit of achteruit lezen.

Misschien in iOS 17. 🤞