Zukünftige Apple-Geräte könnten mit ultrapräzisem Eye-Tracking gesteuert werden

Foto: v2osk auf Unsplash

Passenderweise machen wir uns zu einer Zeit Sorgen, jede Oberfläche ohne zu berühren uns sofort die Hände waschen, hat das US-Patent- und Markenamt eine Eye-Tracking-Patentanmeldung von Apple veröffentlicht, in der eine Methode beschrieben wird, mit der Benutzer eine Schnittstelle mit nur einem einfachen Blick steuern können.

Die Anwendung beleuchtet möglicherweise eine der Funktionen von Apples Gerüchten am Kopf befestigter Bildschirm für Augmented und Virtual Reality.

Apples Anwendung, veröffentlicht Donnerstag und geteilt von Offensichtlich Apple Montag, stellt fest, dass „Bestehende Computersysteme, Sensoren und Anwendungen keine ausreichende Fernverfolgung von Augen für elektronische Geräte ermöglichen, die sich relativ zum Benutzer bewegen.“

Es beschreibt eine Anwendung von Eye-Tracking als „ein Head-Mounted-Display (HMD) [das] sich mit [dem] Benutzer bewegt und Eye-Tracking bereitstellen kann“.

Das ist etwas, das HTC Vive Pro Eye-Headset des letzten Jahres eingeführt. Diese Funktion ermöglicht es, Augenbewegungen, Aufmerksamkeit und Fokus zu verfolgen und zu analysieren. Dies kann verwendet werden, um reaktionsschnellere und immersivere virtuelle Simulationen zu erstellen. Es kann auch verwendet werden, um Einblicke in die Benutzerleistung und -interaktion zu gewinnen. Das macht es möglich, zum Beispiel Trainingsszenarien zu verbessern, die in VR stattfinden.

Foto: Apfel

Eye-Tracking-Patent

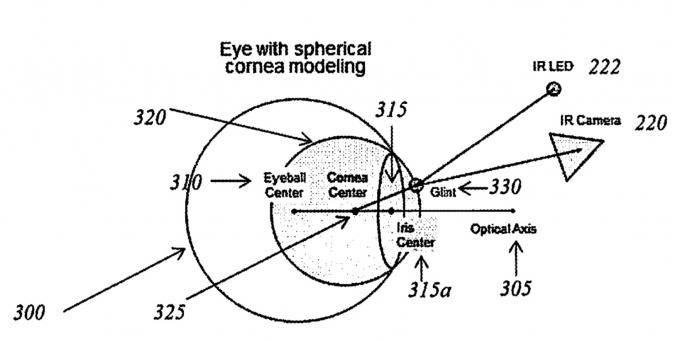

Das System von Apple beschreibt einen Sensor Fusion-Ansatz, bei dem die Blickrichtung identifiziert wird, indem zwei Positionen in einem 3D-Koordinatensystem verfolgt werden. Es verwendet eine einzige aktive Beleuchtungsquelle und Tiefensensordaten. Wie das Patent in Patentschrift beschreibt:

„Einige Implementierungen der Offenbarung beinhalten bei einem Gerät mit einem oder mehreren Prozessoren einen oder mehrere Bildsensoren und eine Beleuchtung.“ Quelle, Erfassen eines ersten Attributs eines Auges basierend auf Pixelunterschieden, die mit unterschiedlichen Wellenlängen des Lichts in einem ersten Bild des. assoziiert sind Auge. Diese Implementierungen bestimmen als nächstes einen ersten Ort, der dem ersten Attribut in einem dreidimensionalen (3D) Koordinatensystem zugeordnet ist, basierend auf Tiefeninformationen von einem Tiefensensor.

Verschiedene Implementierungen erfassen ein zweites Attribut des Auges basierend auf einem Glitzern, das aus Licht der Beleuchtungsquelle resultiert, das von einer Hornhaut des Auges reflektiert wird. Diese Implementierungen bestimmen als nächstes einen zweiten Ort, der dem zweiten Attribut im 3D-Koordinatensystem zugeordnet ist, basierend auf der Tiefe Informationen vom Tiefensensor und bestimmen eine Blickrichtung im 3D-Koordinatensystem basierend auf dem ersten Standort und dem zweiten Lage."

Wie die Patentanmeldung erklärt, könnte sie die Blickrichtung schätzen, indem sie mehrere Bilder eines Auges aufnimmt und diese in 3D-Positionen umwandelt. Wenn beide zusammen verfolgt werden, kann die Blickrichtung genau geschätzt werden.

Worauf bezieht sich das?

Die Tatsache, dass Apple in seiner Patentanmeldung auf ein Head-Mounted-Display verweist, ist keine Garantie dafür, dass dies gemeint ist. Abbildungen in der Patentanmeldung zeigen auch ein iPhone und den iMac. Apple könnte daher daran interessiert sein, dass dies als zukünftiges Schnittstellenfeature plattformübergreifend ist.

Apple hat Eye-Tracking bereits in Patenten untersucht – inklusive Zwei-Personen-Eye-Tracking.